能量模型概览

【摘要】

【原文】 Murphy, Kevin P. Chapter 24 of Probabilistic Machine Learning: Advanced Topics. MIT Press, 2023. probml.ai.

【参考】

1 概述

变分自编码器、自回归模型和归一化流等深度生成模型,都可以用有向图模型来表述,在这些模型中,使用局部归一化的分布一步一步生成数据。但在某些情况下,根据有效样本必须满足的一组约束来指定分布,可能比定义数据生成过程更容易。这可以使用无向图形模型来完成。

基于能量的模型( Eneragy-based Models, EBM )可以被写成 Gibbs 分布,如下所示:

其中 被称为能量函数, 为参数, 为 配分函数:

配分函数相对于 恒定,但却是 的函数。由于 EBM 通常不做任何马尔可夫假设(与概率图模型不同),因此评估此积分非常棘手。因此,通常需要使用近似方法,例如退火重要性采样。

与其他生成模型相比,EBM 的优势在于:能量函数可以是任何能够返回非负标量的函数,而且不需要积分到 ,这让人们可以使用各种神经网络架构来定义能量。因此,EBM 在机器学习的许多领域都有了广泛应用,包括图像生成,判别学习,自然语言处理,密度估计和强化学习等。

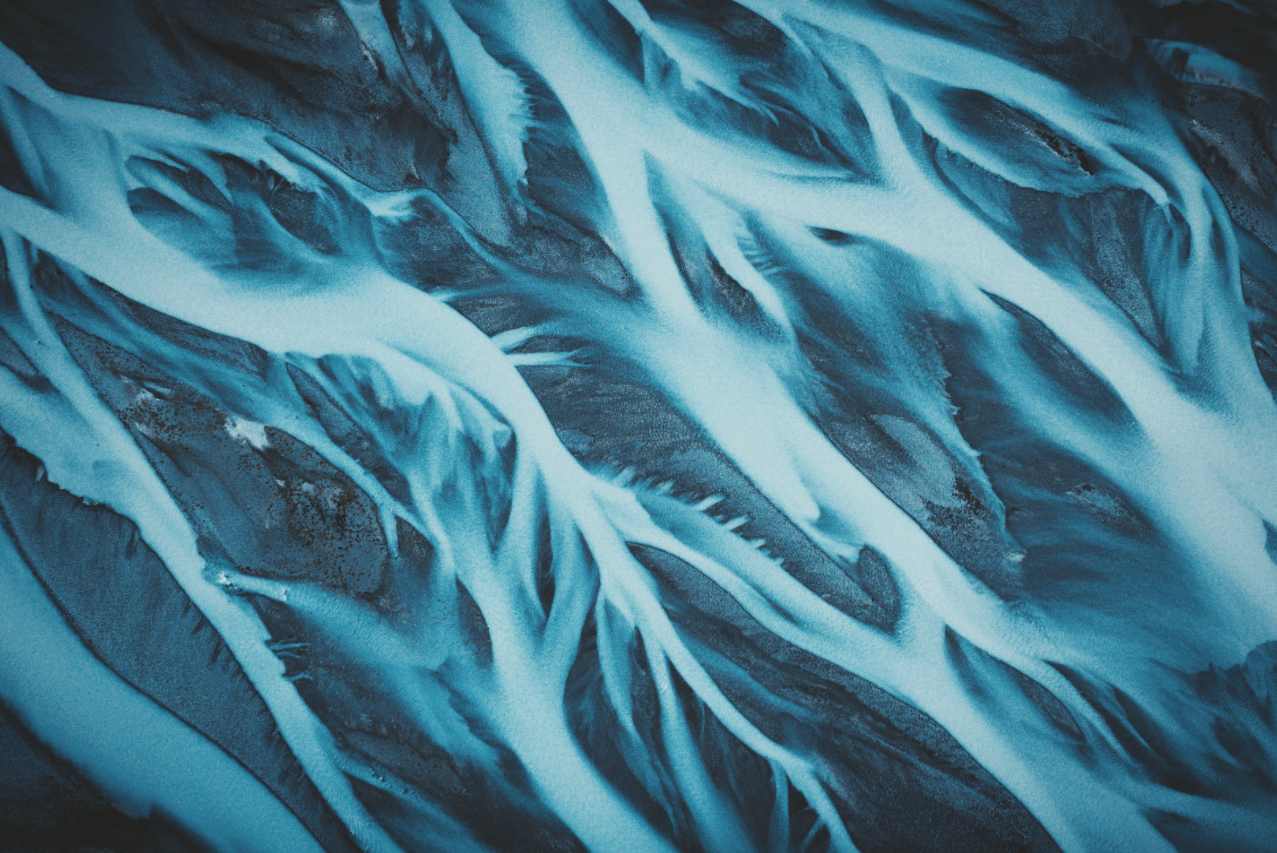

图中还展示了一些朝向高概率(低能量)区域的采样轨迹。来自 [DM19a] 的图 14。

相关参考文献

[Ngi+11;Xie+16; DM19b] [Gra+20b] [Mik+13; Den+20] [Wen+19a; Son+19] [Haa+17; Haa+18a]

Y. Du and I. Mordatch. “Implicit Generation and Generalization in Energy-Based Models”. In: (2019). arXiv: 1903.08689 [cs.LG].

1.1 示例:专家产品 (PoE)

###1.2 计算困难